Основания работы нейронных сетей

Нейронные сети представляют собой математические конструкции, моделирующие функционирование естественного мозга. Созданные нейроны соединяются в слои и перерабатывают информацию поочерёдно. Каждый нейрон принимает входные сведения, применяет к ним математические изменения и транслирует выход следующему слою.

Принцип функционирования martin казино основан на обучении через примеры. Сеть изучает значительные количества сведений и находит правила. В течении обучения алгоритм корректирует скрытые настройки, сокращая неточности прогнозов. Чем больше образцов перерабатывает алгоритм, тем вернее становятся результаты.

Актуальные нейросети решают вопросы классификации, регрессии и создания содержимого. Технология задействуется в медицинской диагностике, экономическом анализе, автономном транспорте. Глубокое обучение обеспечивает формировать системы распознавания речи и картинок с большой достоверностью.

Нейронные сети: что это и зачем они необходимы

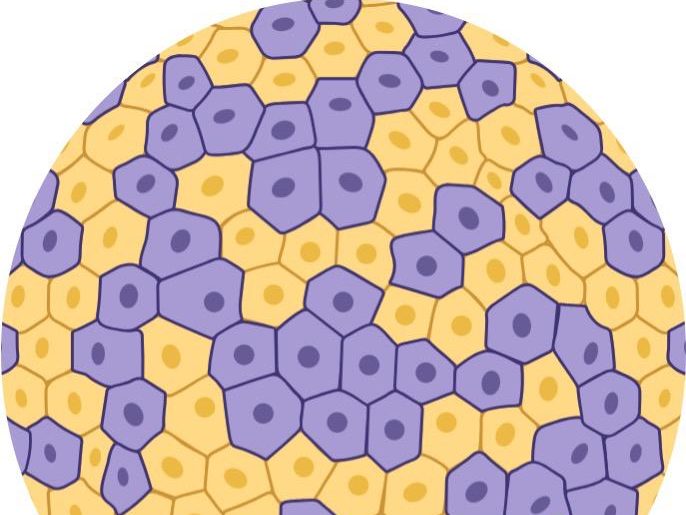

Нейронная сеть состоит из взаимосвязанных расчётных блоков, именуемых нейронами. Эти элементы сформированы в структуру, подобную нервную систему биологических организмов. Каждый созданный нейрон получает сигналы, анализирует их и передаёт дальше.

Ключевое плюс технологии состоит в способности находить сложные закономерности в данных. Обычные алгоритмы нуждаются открытого кодирования правил, тогда как казино Мартин самостоятельно выявляют паттерны.

Прикладное использование покрывает ряд отраслей. Банки определяют поддельные операции. Лечебные заведения исследуют изображения для определения диагнозов. Индустриальные фирмы совершенствуют механизмы с помощью предсказательной статистики. Потребительская торговля настраивает офферы потребителям.

Технология справляется вопросы, невыполнимые традиционным алгоритмам. Распознавание письменного содержимого, автоматический перевод, прогноз хронологических последовательностей продуктивно реализуются нейросетевыми моделями.

Созданный нейрон: организация, входы, веса и активация

Искусственный нейрон является фундаментальным узлом нейронной сети. Узел принимает несколько входных чисел, каждое из которых множится на релевантный весовой коэффициент. Веса определяют важность каждого входного импульса.

После произведения все числа складываются. К полученной итогу прибавляется параметр смещения, который даёт нейрону срабатывать при нулевых сигналах. Bias увеличивает универсальность обучения.

Результат суммирования направляется в функцию активации. Эта процедура трансформирует прямую сочетание в итоговый выход. Функция активации включает нелинейность в преобразования, что жизненно необходимо для реализации комплексных вопросов. Без нелинейной изменения Martin casino не могла бы моделировать комплексные закономерности.

Коэффициенты нейрона настраиваются в течении обучения. Метод регулирует весовые показатели, уменьшая отклонение между прогнозами и реальными данными. Корректная калибровка параметров устанавливает верность деятельности системы.

Архитектура нейронной сети: слои, связи и типы схем

Устройство нейронной сети устанавливает метод организации нейронов и связей между ними. Модель состоит из нескольких слоёв. Начальный слой воспринимает информацию, промежуточные слои перерабатывают информацию, выходной слой формирует выход.

Соединения между нейронами отправляют сигналы от слоя к слою. Каждая связь описывается весовым показателем, который корректируется во процессе обучения. Степень соединений отражается на вычислительную трудоёмкость модели.

Присутствуют разнообразные типы конфигураций:

- Последовательного передачи — данные перемещается от старта к выходу

- Рекуррентные — имеют циклические соединения для обработки рядов

- Свёрточные — концентрируются на обработке снимков

- Радиально-базисные — эксплуатируют функции дистанции для разделения

Определение структуры обусловлен от целевой задачи. Число сети задаёт возможность к вычислению обобщённых характеристик. Верная архитектура Мартин казино создаёт идеальное баланс правильности и быстродействия.

Функции активации: зачем они востребованы и чем различаются

Функции активации конвертируют скорректированную итог входов нейрона в выходной результат. Без этих функций нейронная сеть была бы последовательность прямых преобразований. Любая композиция простых операций остаётся прямой, что сужает потенциал архитектуры.

Непрямые операции активации обеспечивают аппроксимировать комплексные зависимости. Сигмоида сжимает числа в интервал от нуля до единицы для двоичной разделения. Гиперболический тангенс генерирует выходы от минус единицы до плюс единицы.

Функция ReLU обнуляет минусовые числа и сохраняет позитивные без корректировок. Простота вычислений создаёт ReLU востребованным вариантом для многослойных сетей. Варианты Leaky ReLU и ELU устраняют задачу уменьшающегося градиента.

Softmax применяется в выходном слое для многокатегориальной разделения. Функция преобразует набор величин в разбиение шансов. Выбор преобразования активации отражается на скорость обучения и качество деятельности казино Мартин.

Обучение с учителем: погрешность, градиент и возвратное прохождение

Обучение с учителем применяет подписанные сведения, где каждому входу отвечает корректный выход. Система создаёт предсказание, после система определяет отклонение между предсказанным и действительным параметром. Эта расхождение именуется метрикой ошибок.

Цель обучения заключается в снижении отклонения посредством корректировки весов. Градиент указывает направление сильнейшего повышения функции отклонений. Алгоритм перемещается в противоположном направлении, уменьшая погрешность на каждой цикле.

Алгоритм обратного распространения определяет градиенты для всех весов сети. Метод отправляется с финального слоя и движется к начальному. На каждом слое рассчитывается влияние каждого веса в общую погрешность.

Скорость обучения управляет масштаб корректировки коэффициентов на каждом цикле. Слишком высокая скорость ведёт к колебаниям, слишком малая снижает конвергенцию. Алгоритмы типа Adam и RMSprop динамически настраивают темп для каждого веса. Правильная калибровка хода обучения Мартин казино задаёт качество результирующей архитектуры.

Переобучение и регуляризация: как избежать “зазубривания” данных

Переобучение возникает, когда система слишком чрезмерно подстраивается под тренировочные данные. Сеть запоминает специфические случаи вместо определения универсальных зависимостей. На свежих данных такая система показывает слабую точность.

Регуляризация образует комплекс методов для предотвращения переобучения. L1-регуляризация прибавляет к метрике отклонений сумму абсолютных параметров параметров. L2-регуляризация применяет сумму квадратов коэффициентов. Оба метода ограничивают систему за избыточные весовые параметры.

Dropout рандомным методом блокирует часть нейронов во время обучения. Приём побуждает систему разносить данные между всеми элементами. Каждая шаг настраивает слегка изменённую архитектуру, что повышает устойчивость.

Досрочная остановка останавливает обучение при снижении метрик на контрольной подмножестве. Расширение объёма тренировочных информации снижает вероятность переобучения. Обогащение производит вспомогательные варианты через трансформации начальных. Сочетание приёмов регуляризации создаёт качественную генерализующую возможность Martin casino.

Главные разновидности сетей: полносвязные, сверточные, рекуррентные

Разнообразные структуры нейронных сетей специализируются на решении специфических типов проблем. Выбор категории сети зависит от организации исходных данных и нужного ответа.

Ключевые разновидности нейронных сетей включают:

- Полносвязные сети — каждый нейрон соединён со всеми нейронами следующего слоя, применяются для табличных сведений

- Сверточные сети — эксплуатируют преобразования свертки для обработки изображений, самостоятельно вычисляют геометрические характеристики

- Рекуррентные сети — включают циклические связи для анализа серий, сохраняют информацию о прошлых компонентах

- Автокодировщики — кодируют сведения в краткое кодирование и воспроизводят начальную информацию

Полносвязные конфигурации нуждаются значительного числа параметров. Свёрточные сети эффективно справляются с картинками за счёт sharing параметров. Рекуррентные архитектуры обрабатывают документы и последовательные последовательности. Трансформеры заменяют рекуррентные структуры в задачах анализа языка. Комбинированные топологии объединяют преимущества различных категорий Мартин казино.

Сведения для обучения: подготовка, нормализация и разбиение на подмножества

Качество данных прямо задаёт результативность обучения нейронной сети. Обработка содержит чистку от дефектов, заполнение пропущенных величин и ликвидацию повторов. Некорректные информация приводят к неверным выводам.

Нормализация преобразует характеристики к общему диапазону. Отличающиеся промежутки величин формируют асимметрию при определении градиентов. Минимаксная нормализация сжимает величины в интервал от нуля до единицы. Стандартизация смещает данные относительно медианы.

Данные разделяются на три набора. Тренировочная набор используется для корректировки коэффициентов. Проверочная позволяет выбирать гиперпараметры и проверять переобучение. Тестовая проверяет конечное производительность на независимых информации.

Типичное баланс равняется семьдесят процентов на обучение, пятнадцать на проверку и пятнадцать на тестирование. Кросс-валидация делит сведения на несколько частей для устойчивой оценки. Выравнивание категорий исключает перекос модели. Верная предобработка данных критична для продуктивного обучения казино Мартин.

Реальные внедрения: от выявления образов до генеративных архитектур

Нейронные сети внедряются в широком круге практических проблем. Компьютерное зрение задействует свёрточные структуры для определения сущностей на фотографиях. Комплексы безопасности выявляют лица в условиях текущего времени. Медицинская диагностика исследует кадры для определения аномалий.

Переработка человеческого языка обеспечивает формировать чат-боты, переводчики и механизмы определения тональности. Голосовые агенты понимают речь и генерируют отклики. Рекомендательные системы угадывают склонности на фундаменте хроники поступков.

Создающие системы производят оригинальный материал. Генеративно-состязательные сети генерируют достоверные изображения. Вариационные автокодировщики создают модификации существующих элементов. Лингвистические модели формируют документы, копирующие людской почерк.

Автономные перевозочные устройства эксплуатируют нейросети для навигации. Финансовые организации предсказывают рыночные тенденции и измеряют заёмные риски. Промышленные компании совершенствуют процесс и предвидят сбои техники с помощью Martin casino.