Что такое Big Data и как с ними функционируют

Big Data составляет собой объёмы сведений, которые невозможно переработать традиционными способами из-за большого объёма, быстроты прихода и вариативности форматов. Современные предприятия каждодневно формируют петабайты сведений из различных ресурсов.

Процесс с большими информацией охватывает несколько фаз. Сначала информацию накапливают и систематизируют. Затем информацию фильтруют от погрешностей. После этого эксперты внедряют алгоритмы для извлечения закономерностей. Финальный стадия — отображение выводов для формирования решений.

Технологии Big Data предоставляют фирмам приобретать конкурентные достоинства. Торговые компании рассматривают клиентское действия. Кредитные определяют фродовые транзакции mostbet зеркало в режиме актуального времени. Лечебные учреждения внедряют анализ для выявления патологий.

Главные понятия Big Data

Теория масштабных информации строится на трёх основных характеристиках, которые именуют тремя V. Первая особенность — Volume, то есть масштаб сведений. Фирмы переработывают терабайты и петабайты данных регулярно. Второе свойство — Velocity, быстрота создания и анализа. Социальные сети создают миллионы публикаций каждую секунду. Третья черта — Variety, разнообразие структур сведений.

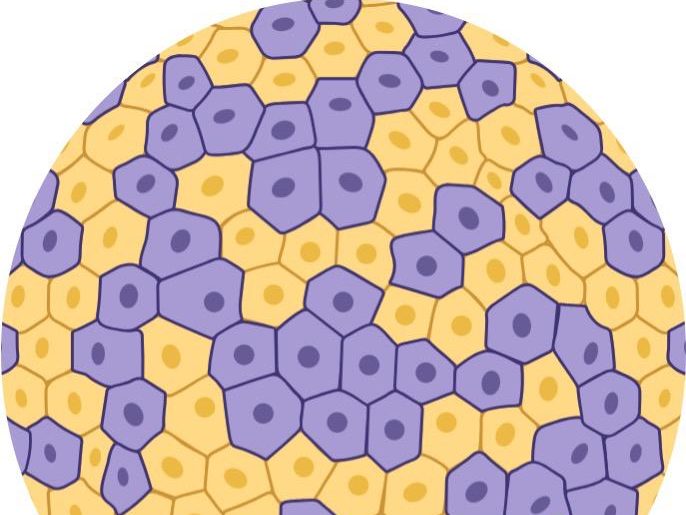

Структурированные сведения упорядочены в таблицах с конкретными столбцами и рядами. Неупорядоченные информация не содержат заранее фиксированной модели. Видеофайлы, аудиозаписи, письменные материалы принадлежат к этой типу. Полуструктурированные информация занимают смешанное место. XML-файлы и JSON-документы мостбет содержат маркеры для упорядочивания сведений.

Разнесённые платформы хранения распределяют данные на ряде серверов параллельно. Кластеры объединяют расчётные возможности для распределённой переработки. Масштабируемость обозначает способность увеличения потенциала при росте объёмов. Надёжность обеспечивает сохранность информации при выходе из строя узлов. Дублирование генерирует дубликаты сведений на различных машинах для достижения стабильности и скорого доступа.

Ресурсы значительных данных

Сегодняшние структуры собирают сведения из ряда ресурсов. Каждый источник производит особые виды сведений для полного исследования.

Основные ресурсы объёмных информации включают:

- Социальные сети формируют текстовые сообщения, фотографии, видео и метаданные о клиентской деятельности. Системы регистрируют лайки, репосты и мнения.

- Интернет вещей интегрирует смарт гаджеты, датчики и сенсоры. Персональные приборы фиксируют телесную нагрузку. Техническое машины передаёт сведения о температуре и эффективности.

- Транзакционные платформы записывают финансовые операции и приобретения. Банковские приложения регистрируют операции. Интернет-магазины сохраняют записи приобретений и склонности потребителей mostbet для индивидуализации рекомендаций.

- Веб-серверы накапливают логи визитов, клики и переходы по сайтам. Поисковые сервисы анализируют поиски пользователей.

- Мобильные сервисы отправляют геолокационные сведения и сведения об эксплуатации возможностей.

Способы получения и хранения данных

Получение больших сведений реализуется разнообразными технологическими приёмами. API позволяют системам автоматически получать информацию из удалённых ресурсов. Веб-скрейпинг извлекает сведения с сайтов. Постоянная трансляция обеспечивает беспрерывное приход сведений от сенсоров в режиме настоящего времени.

Архитектуры накопления крупных информации подразделяются на несколько классов. Реляционные системы систематизируют сведения в таблицах со соединениями. NoSQL-хранилища используют изменяемые структуры для неструктурированных данных. Документоориентированные хранилища записывают информацию в формате JSON или XML. Графовые системы концентрируются на фиксации взаимосвязей между элементами mostbet для исследования социальных сетей.

Децентрализованные файловые архитектуры располагают данные на множестве серверов. Hadoop Distributed File System разбивает данные на фрагменты и дублирует их для надёжности. Облачные хранилища дают гибкую платформу. Amazon S3, Google Cloud Storage и Microsoft Azure обеспечивают соединение из каждой точки мира.

Кэширование ускоряет доступ к часто запрашиваемой данных. Системы сохраняют актуальные сведения в оперативной памяти для мгновенного доступа. Архивирование перемещает нечасто применяемые объёмы на дешёвые хранилища.

Средства обработки Big Data

Apache Hadoop является собой фреймворк для децентрализованной обработки массивов данных. MapReduce делит операции на компактные фрагменты и выполняет вычисления синхронно на совокупности машин. YARN регулирует возможностями кластера и раздаёт задачи между mostbet серверами. Hadoop анализирует петабайты сведений с большой стабильностью.

Apache Spark превосходит Hadoop по производительности анализа благодаря задействованию оперативной памяти. Платформа производит действия в сто раз скорее традиционных платформ. Spark обеспечивает пакетную переработку, непрерывную обработку, машинное обучение и графовые вычисления. Инженеры создают скрипты на Python, Scala, Java или R для построения обрабатывающих программ.

Apache Kafka предоставляет потоковую отправку данных между платформами. Решение обрабатывает миллионы записей в секунду с минимальной замедлением. Kafka фиксирует серии действий мостбет казино для будущего обработки и объединения с альтернативными инструментами переработки данных.

Apache Flink фокусируется на переработке потоковых информации в актуальном времени. Технология изучает события по мере их прихода без остановок. Elasticsearch индексирует и обнаруживает данные в крупных массивах. Решение обеспечивает полнотекстовый поиск и обрабатывающие инструменты для записей, параметров и файлов.

Анализ и машинное обучение

Исследование больших сведений выявляет ценные взаимосвязи из массивов данных. Дескриптивная подход характеризует состоявшиеся происшествия. Диагностическая подход определяет причины проблем. Прогностическая подход предсказывает грядущие тренды на фундаменте накопленных информации. Рекомендательная методика подсказывает лучшие действия.

Машинное обучение автоматизирует определение тенденций в информации. Модели тренируются на данных и улучшают правильность прогнозов. Управляемое обучение применяет маркированные сведения для классификации. Алгоритмы предсказывают классы элементов или числовые величины.

Неконтролируемое обучение определяет латентные паттерны в немаркированных данных. Группировка группирует подобные объекты для разделения заказчиков. Обучение с подкреплением настраивает цепочку операций мостбет казино для увеличения награды.

Нейросетевое обучение использует нейронные сети для распознавания паттернов. Свёрточные модели исследуют изображения. Рекуррентные архитектуры переработывают письменные последовательности и временные серии.

Где используется Big Data

Розничная сфера внедряет большие сведения для индивидуализации покупательского переживания. Магазины изучают хронологию покупок и генерируют индивидуальные советы. Платформы прогнозируют спрос на товары и настраивают резервные объёмы. Торговцы фиксируют перемещение потребителей для совершенствования позиционирования изделий.

Денежный отрасль применяет анализ для определения фродовых операций. Финансовые изучают закономерности действий клиентов и запрещают подозрительные манипуляции в актуальном времени. Кредитные институты определяют платёжеспособность заёмщиков на фундаменте ряда показателей. Спекулянты применяют системы для предсказания динамики котировок.

Здравоохранение задействует технологии для оптимизации определения патологий. Медицинские институты исследуют итоги проверок и обнаруживают первичные сигналы недугов. Генетические проекты мостбет казино анализируют ДНК-последовательности для разработки индивидуальной медикаментозного. Портативные девайсы регистрируют данные здоровья и предупреждают о критических изменениях.

Транспортная область совершенствует доставочные пути с содействием изучения сведений. Фирмы снижают расход топлива и время доставки. Смарт города координируют транспортными потоками и уменьшают скопления. Каршеринговые службы прогнозируют потребность на автомобили в различных локациях.

Трудности сохранности и секретности

Охрана объёмных данных представляет существенный вызов для предприятий. Массивы данных хранят индивидуальные информацию потребителей, финансовые данные и коммерческие тайны. Компрометация сведений причиняет репутационный убыток и ведёт к материальным потерям. Злоумышленники нападают серверы для кражи важной сведений.

Кодирование ограждает сведения от несанкционированного проникновения. Алгоритмы трансформируют сведения в закрытый вид без специального ключа. Компании мостбет криптуют информацию при пересылке по сети и сохранении на серверах. Многоуровневая идентификация определяет идентичность клиентов перед выдачей подключения.

Юридическое регулирование устанавливает правила использования частных данных. Европейский стандарт GDPR обязывает получения согласия на сбор информации. Предприятия обязаны оповещать пользователей о намерениях применения данных. Нарушители перечисляют пени до 4% от годового дохода.

Деперсонализация устраняет опознавательные характеристики из наборов информации. Методы маскируют названия, координаты и персональные атрибуты. Дифференциальная приватность вносит статистический шум к итогам. Способы обеспечивают изучать паттерны без раскрытия сведений определённых граждан. Управление подключения сужает права персонала на изучение закрытой сведений.

Перспективы технологий крупных сведений

Квантовые операции преобразуют анализ значительных данных. Квантовые компьютеры справляются тяжёлые задачи за секунды вместо лет. Решение ускорит криптографический исследование, оптимизацию маршрутов и симуляцию химических конфигураций. Компании вкладывают миллиарды в разработку квантовых вычислителей.

Периферийные вычисления перемещают переработку информации ближе к точкам генерации. Приборы обрабатывают информацию местно без трансляции в облако. Подход уменьшает паузы и сберегает канальную способность. Самоуправляемые транспорт формируют решения в миллисекундах благодаря переработке на борту.

Искусственный интеллект превращается важной составляющей аналитических решений. Автоматизированное машинное обучение выбирает эффективные алгоритмы без вмешательства экспертов. Нейронные архитектуры создают синтетические сведения для тренировки систем. Технологии интерпретируют принятые решения и укрепляют доверие к рекомендациям.

Децентрализованное обучение мостбет обеспечивает настраивать системы на разнесённых информации без общего хранения. Устройства обмениваются только данными алгоритмов, сохраняя конфиденциальность. Блокчейн предоставляет открытость данных в разнесённых решениях. Решение гарантирует истинность информации и ограждение от фальсификации.